深度感知技术全解析:dToF为何成为机器人之眼的新宠?

在机器人、自动驾驶、工业自动化和智能物流蓬勃发展的今天,”如何精准感知三维世界”已成为整个行业最核心的命题之一。深度感知技术,赋予了机器一双能够测量距离、理解空间的”眼睛”。

从微软2010年发布的Kinect,到苹果2017年iPhone X的Face ID,再到如今服务机器人、无人叉车和自动驾驶汽车上搭载的各类3D传感器——深度感知技术已经从实验室走向了千行百业。

本文将深度剖析双目视觉、结构光、iToF、dToF四大主流3D视觉传感器的原理、优缺点、适用场景及市场趋势,并带您了解为什么dToF(直接飞行时间法)正在成为中远距离3D视觉感知领域最具潜力的技术新星。

丨 一、四大深度感知技术原理深度解析

目前主流的3D视觉传感器感知技术包括双目视觉、结构光和ToF,而ToF则分为iToF(间接飞行时间)和dToF(直接飞行时间)。

技术一:双目视觉(Stereo Vision)

模仿人眼视差原理的被动式测距技术,分为被动双目和主动双目两种

工作原理:双目深度重建利用三角测距法计算被测物体到相机的距离。从两个相机观察同一物体,被观测物体在两幅图像中的位置差称为视差,被摄物离相机越近,视差越大;距离越远,视差越小。

在已知两个相机间距等相对位置关系的情况下,即可通过相似三角形原理计算出距离。双目视觉方案又分为被动和主动两种,主动双目是被动双目的加强版,通过红外补光解决了暗光和低纹理的痛点,但在远距离精度、强光干扰等问题上,没有根本改善。

核心优势:

• 被动双目无需主动光源,硬件结构相对简单,成本较低

• 在纹理丰富、光照充足的场景下效果良好

• 近距离时可获取高分辨率深度图

技术瓶颈:

• 计算量巨大:块匹配算法复杂度高达O(NMWHD),实际应用中通常需要专用ASIC芯片加速

• 强依赖纹理:面对白墙、玻璃等低纹理表面时,无法找到对应匹配点

• 光照敏感:黑暗环境或强光直射下性能急剧下降,红外补光的主动双目结构有改善

• 远距离精度衰减:精度随距离平方下降,中远距离误差显著增大

典型代表:被动双目有Stereolabs ZED系列;主动双目有RealSense D400系列、Luxonis OAK系列

技术二:结构光(Structured Light)

主动投射编码图案,通过图案形变直接求解深度的三角测距技术

工作原理:结构光方案是一种主动三角测量技术,与主动双目同属主动三角法大类。其工作方式是红外激光投射端将带有编码信息的结构光图案(如条纹、网格、伪随机点阵)投影到被观测物体上。

这些图案会根据物体的几何形状和距离发生相应的形变(如条纹弯曲、点位移)。红外摄像头拍摄这些形变图案,系统通过解码分析图案的形变程度,直接计算出每个像素对应的深度信息。

与主动双目的区别:主动双目是通过匹配左右图像中的对应点来计算视差,需要依赖图像间的对应关系。但结构光是通过解码图案形变直接获得深度,每个投射的特征点自带“身份标签”,不依赖双目匹配。

核心优势:

• 主动光源补充纹理:解决了被动双目在低纹理、弱光场景下的痛点

• 近距离精度极高:可达亚毫米级,如苹果Face ID模组

• 无需双目匹配:每个投射的特征点自带编码信息,计算路径更直接

技术瓶颈:

• 测距范围有限:最佳工作距离通常为0.3-3米,远距离精度随距离平方下降

• 多路径干扰:复杂场景中多次反射会导致深度计算错误

• 同类设备干扰:多台结构光设备投射出的图案会混淆,导致无法解算

• 阳光干扰:户外强光下投射图案易被淹没,工作受限

典型代表:消费级有苹果Face ID模组、奥比中光 Astra 系列(主要用于近距离人脸识别、三维建模等场景);工业级/融合方案有Photoneo MotionCam-3D 系列、Mech-Mind (梅卡曼德) Mech-Eye 系列

注:结构光与主动双目虽然硬件架构相似,但深度计算逻辑不同。两者同属主动三角法大类,但在近距离高精度场景中,结构光更具优势;在中远距离及动态场景中,主动双目表现更优。

技术三:iToF(间接飞行时间)

通过相位差间接推算光飞行时间的测距方案

工作原理:iToF(indirect Time-of-Flight)通过传感器在不同时间窗口采集能量值的比例关系,解析信号相位,间接测量发射信号与接收信号的时间差。主要分为两种调制方式:

CW-iToF(连续波调制):采用正弦波调制,接收与发射端正弦波的相位偏移和物体距离成正比。精度受制于随机噪声和量化噪声,为提高精度通常采用大功率短积分时间采样+高调制频率。

PL-iToF(脉冲调制):激光发射带有振幅和时间信息的光脉冲,通过双采样技术提高精度。解算更简单、计算量更低,但精度弱于CW-iToF,对背景噪声更敏感。

核心优势:

• 芯片产业链成熟

• 实时性较好

技术瓶颈:

• 飞点噪声(Flying Pixels):物体边缘处,单个像素同时接收到前景和背景的反射光线,导致深度值错误,生成“飞在空中的无效点”

• 多径干扰(MPI):真实场景中,复杂漫反射或镜面反射使光线经多次反射后才被传感器接收,导致测量值系统性偏大。这是困扰 iToF 多年的最大技术障碍

• 对黑色物体敏感度高:黑色物体吸光性强,反射信号弱,导致信噪比急剧下降,深度数据容易出现空洞或失效,难以稳定检测深色目标

• 多机干扰严重:多台 iToF 设备在同一区域同时工作时,调制信号相互叠加干扰,导致深度数据大面积错误或完全失效,限制了其在密集集群场景中的应用

典型芯片厂家:SONY、Infineon、PMD

典型模组产品:Lucid Helios2 系列、SICK Visionary-T Mini、IFM 3D相机、迈尔微视 M 系列

技术四

dToF(直接飞行时间)※

直接测量光子往返时间的终极测距方案

工作原理:

dToF(direct Time-of-Flight)技术直接测量光脉冲的发射和接收时间差。由于激光安全限制和消费产品功耗限制,ToF相机发射的脉冲能量有限,但经过反射回到接收器时,能量密度降低了超过一万亿倍。环境光作为噪声,会严重干扰信号检测。

因此,dToF需要灵敏度极高的光探测器——单光子雪崩二极管(SPAD)。SPAD在工作状态下是一个偏置了高逆向电压的二极管,当一个光子被吸收转化为自由电子时,内部强大电场加速该电子,撞击产生更多载流子,形成几何级数放大的雪崩效应,从而输出大电流脉冲,实现对单个光子的探测。

dToF采用TCSPC(时间相关单光子计数)方法实现皮秒级时间精度。系统重复数千到数十万次发射-探测相同脉冲信号,获得每次探测的统计分布直方图,重建光脉冲能量随时间的变化曲线,进而得到精确的飞行时间。

核心优势:

• 距离精度:在正常工作范围内,误差随距离增加无明显放大,中远距离仍可保持厘米级精度

• 多径干扰抑制:直接测量首波到达时间,受多径反射影响远小于iToF

• 低功耗高效率:单次脉冲即可完成测距,计算量极低,延迟更小

• 环境光适应性:采用时间门控技术,配合窄带滤光片与近红外光源(典型波长 940nm),可在100kLux 高光照条件下获取有效深度数据

• 多机协同友好:不同设备的脉冲时序可错开,原生支持多机同时工作

• 实时性:无需复杂匹配算法,深度数据可直接输出,帧率可达10-20fps

技术瓶颈(已逐步突破):

• SPAD暗计数率(DCR):通过 3D 堆叠工艺和淬灭电路优化,较早期方案有所改善

• 光子探测效率(PDE):BSI背照式工艺的应用,提升了感光效率

• 片上集成度:随着先进制程发展,SPAD阵列+TDC+直方图算法已可片上集成

• 空间分辨率较低:受限于SPAD 的物理尺寸和后端计数电路(TDC)的复杂性,分辨率普遍比 iToF 低一些

典型芯片厂家:海思、芯视界、识光、Sony、STMicroelectronics

典型模组产品:迈尔微视S系列(在移动机器人领域有较高知名度)

丨 二、四大核心技术参数对比

丨 三、市场数据与趋势:dToF正在改写格局

根据Yole Group、Mordor Intelligence、IndustryARC等多家权威市场研究机构数据,深度感知市场正经历结构性变革:

关键市场数据:

• 全球3D传感器市场2025年估值约70亿美元,预计2032年达到190亿美元(CAGR 16.1%)

• ToF传感器市场2025年规模约44.3亿美元,预计2030年达到159.6亿美元(CAGR 20.32%)

• dToF细分市场2023年占ToF市场37.77%份额,正以22.6%的CAGR高速增长,远超iToF增速

趋势解读:

- iToF主导消费端,dToF领跑工业与汽车:2025年iToF仍占ToF市场62.4%份额,主要得益于智能手机、 webcam等消费应用的成熟产业链。但dToF正以22.6%的CAGR高速追赶,在机器人、自动驾驶、工业自动化等中远距离场景中优势明显。

- 机器人与自动驾驶是dToF核心驱动力:具身智能、机器人3D视觉传感器市场2024年约1.02亿美元,预计2031年达到18.47亿美元(CAGR 52%)。汽车LiDAR市场中dToF因精度和响应优势,正快速取代iToF方案。

丨 四、深度感知技术的核心应用场景

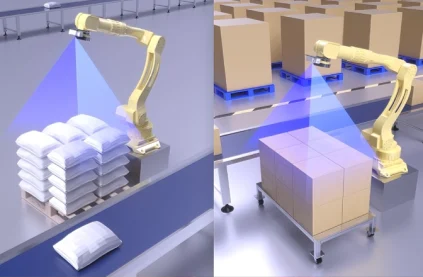

1. 移动机器人避障与导航

2D激光雷达只能扫描单一平面,无法感知低矮或悬空障碍物。dToF三维相机可实时获取周围环境的三维信息和RGB纹理信息,感知低矮、悬空障碍物,结合语义识别算法,不仅可识别障碍物的位置和大小,还能理解其类型(人、货架、墙体等)。

2. 户外强光作业

港口、矿区、光伏电站等场景光照强度可达100kLux以上。iToF方案在此环境下几乎失效,而dToF凭借940nm窄带滤光+时间门控技术,可在100kLux强光下稳定输出高精度深度数据。

3. 物流仓储与体积测量

3D视觉体积测量方案可在复杂环境中高效测量,同时获取多个目标物体的三维数据,精度达毫米级,速度达毫秒级,适用于异形高反光和大宗货物等复杂形态物体。

4. 自动驾驶

汽车自动驾驶领域是3D成像和传感市场的主要增量。dToF LiDAR因响应速度快、精度高,正成为L3级以上自动驾驶的核心传感器。

丨 五、未来展望:dToF的技术演进路线

随着2020年苹果iPad Pro搭载dToF LiDAR发布,dToF技术进入快速迭代发展阶段。未来5年,dToF的技术演进将集中在以下几个方向:

1. SPAD工艺持续升级:3D堆叠工艺将进一步降低暗计数率(DCR)、提升光子探测效率(PDE)、减小时间抖动(Jitter),推动探测距离向50米以上延伸。

2. 分辨率提升:当前主流dToF分辨率在QVGA-VGA级别,随着像素尺寸微缩和阵列集成技术进步,高清dToF将成为可能。

3. 固态化与芯片化:纯固态dToF方案正逐步替代传统机械旋转式激光雷达,在可靠性、体积、功耗及量产成本上全面占优。

迈尔微视S系列:dToF技术的国产标杆

作为国内首家专注于移动机器人视觉技术的企业,迈尔微视(MRDVS)深耕dToF深度感知技术,推出S系列工业级RGB-D相机,为移动机器人、无人叉车、无人机、割草机等设备提供高性能深度感知方案。10 / S10P

S10 / S10Pro — 中远距离避障旗舰ro — 中远距离避障旗舰

基于dToF技术,标准版覆盖0.3-8米,Pro版最长覆盖0.3-17米。120°×80°超大视场角,100kLux抗强光,内置避障算法。

S10 Ultra — 雷视一体高端方案

小体积、大视场角、高性价比工业级雷视一体相机。0.2-42m超远测距,内置IMU(200Hz),支持主流SLAM算法,IP67防护等级,专为割草机器人、四足机器人、多旋翼无人机设计。

S11 — 轻量级dToF RGBD相机

专为移动机器人设计的全固态小体积RGB-D相机,仅90×25×25mm / 90g,0.1-6米(室外)/ 10米(室内)测距,最高1cm精度,支持网口/USB/MIPI三种接口,清洁机器人、AGV/AMR、服务机器人的理想选择。

SB/MIPI

写在最后

深度感知技术的选择,本质上是应用场景、精度需求、成本预算三者之间的权衡。双目视觉适合低成本、近距离、纹理丰富的场景;结构光适合高精度、近距离的室内应用;iToF在消费级中近距离场景中有优势。

但当更多应用走向户外强光、中远距离、实时响应、多机协同时,dToF凭借其精度恒定、计算高效、抗光线干扰强、多机友好的特性,正在成为机器人之眼的最优解。

迈尔微视通过深耕客户真实应用场景,以dToF技术为核心,提供多元化、可定制的产品矩阵,可灵活嵌入各类机器人及智能感知方案中。